数据分析师必备的9大技能 掌握大数据处理技术

在数据驱动的时代,数据分析师已成为各行各业不可或缺的角色。面对海量、多样、高速的大数据,数据分析师不仅需要具备传统的数据分析能力,更要掌握先进的大数据处理技术。以下是数据分析师必须精通的9项核心技能,它们构成了从数据获取到价值变现的完整能力闭环,其中大数据处理技术是重中之重。

- 数据获取与整合能力:数据分析始于数据。分析师需要熟练运用API接口、网络爬虫(如Python的Scrapy、BeautifulSoup)或ETL(提取、转换、加载)工具(如Apache NiFi, Talend)从异构数据源(数据库、日志、传感器、社交媒体等)中高效、合规地获取原始数据。

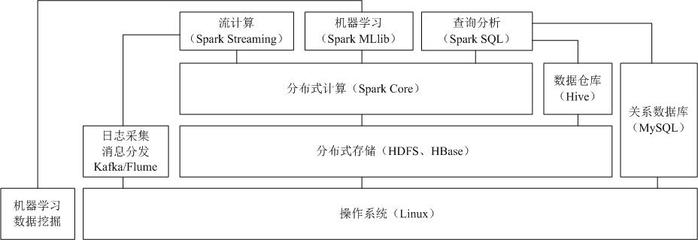

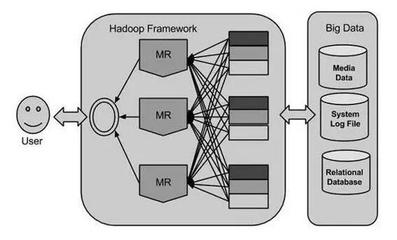

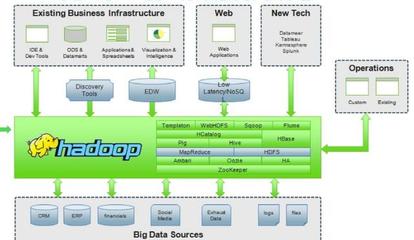

- 大数据处理与存储技术:这是应对海量数据的核心。必须深入理解分布式计算框架,如Hadoop的MapReduce和Spark(以其内存计算速度著称),用于处理PB级数据。需熟悉大数据存储方案,包括HDFS、NoSQL数据库(如HBase, Cassandra用于非结构化数据)、以及云数据仓库(如Snowflake, BigQuery)。

- 数据清洗与预处理:原始数据常包含噪声、缺失值和异常值。分析师需利用编程(Python/Pandas, R/dplyr)或工具(如Trifacta)进行数据清洗、转换、归一化和特征工程,为后续分析奠定高质量数据基础。

- 编程与统计建模:Python和R是行业标准语言。Python凭借Pandas, NumPy, Scikit-learn等库在数据处理和机器学习领域占主导;R则在统计分析和可视化方面有独特优势。扎实的统计学知识(假设检验、回归分析、概率分布)是构建可靠模型的理论根基。

- 机器学习与预测分析:从描述性分析进阶到预测性和规范性分析。需掌握监督学习(回归、分类)、无监督学习(聚类、降维)等算法,并能使用MLlib(Spark)、TensorFlow或PyTorch等框架在大数据平台上实施模型训练与优化。

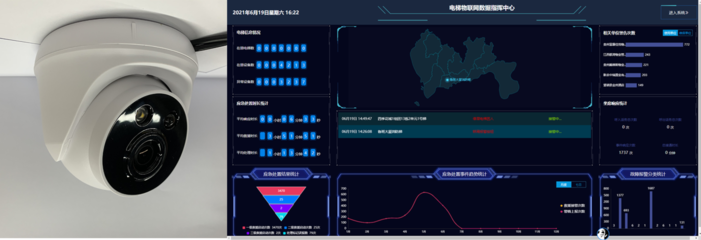

- 数据可视化与故事讲述:将复杂结果转化为直观洞察。精通Tableau、Power BI或Matplotlib、Seaborn(Python)、ggplot2(R)等工具,创建交互式仪表板和报告。更重要的是,具备将数据发现编织成有说服力商业叙事的能力,驱动决策。

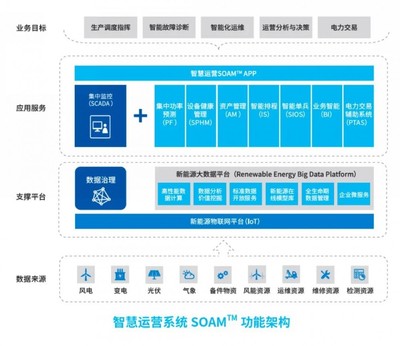

- 大数据平台与云技术:现代大数据处理离不开云。熟悉至少一家主流云服务平台(如AWS的EMR、S3;Azure的HDInsight;GCP的Dataproc)的大数据组件和服务,理解其架构、成本与伸缩性,能够进行云端数据流水线设计和部署。

- SQL与高级查询能力:尽管NoSQL盛行,SQL仍是访问和处理关系型及大数据(通过Hive, Spark SQL)的基石。必须能编写复杂查询、进行连接、聚合和窗口函数操作,高效地从大规模数据集中提取信息。

- 领域知识与商业敏锐度:技术是手段,解决业务问题才是目的。深刻理解所在行业(如金融、电商、医疗)的业务流程、关键指标(KPIs)和挑战,才能确保数据分析方向正确并产生实际商业价值。

聚焦大数据处理技术:在以上九项技能中,大数据处理技术(技能2、4、7、8的交叉领域)是区分普通数据分析师与能够应对现代数据规模的分析师的关键。它要求分析师不仅会使用工具,更要理解分布式系统原理(如容错、数据分区)、计算与存储分离架构、以及流处理技术(如Apache Kafka, Flink)以应对实时数据。掌握这些,意味着能从“大数据”中真正挖掘出“大价值”。

成为一名顶尖的数据分析师,需要构建一个融合了强大技术栈(尤其是大数据处理能力)、严谨统计思维和深刻商业理解的综合技能体系。持续学习与实践,方能在数据的海洋中精准导航,成为驱动企业智能决策的核心引擎。

如若转载,请注明出处:http://www.sdlysll.com/product/26.html

更新时间:2026-04-16 20:11:52