大数据技术之Hadoop 分布式处理的开源基石

在当今信息爆炸的时代,数据正以前所未有的速度和规模生成,从社交媒体动态、电商交易记录到物联网传感器信息,构成了我们常说的“大数据”。面对海量、多样、高速且价值密度低的庞大数据集,传统的数据存储与处理技术已显得力不从心。在这一背景下,Hadoop应运而生,并迅速成为大数据处理领域最具代表性和影响力的开源技术框架。

一、Hadoop的诞生与核心思想

Hadoop的起源可以追溯到Google公司于2003年至2004年间发表的两篇奠基性论文:《Google文件系统(GFS)》和《MapReduce:简化大规模数据集群上的数据处理》。这两篇论文阐述了如何利用大量廉价、普通的商用服务器,构建一个可靠、可扩展的分布式系统,以处理网页索引等海量数据计算问题。受此启发,Doug Cutting等人创建了开源项目Hadoop,其名称来源于Doug Cutting儿子的一只玩具大象的名字。

Hadoop的核心设计思想是 “分而治之” 和 “移动计算而非移动数据” 。它假设硬件故障是常态而非例外,因此将数据分散存储在多台机器上,并在数据所在的节点上进行并行计算,从而极大地提高了数据处理的吞吐量和可靠性,同时降低了成本。

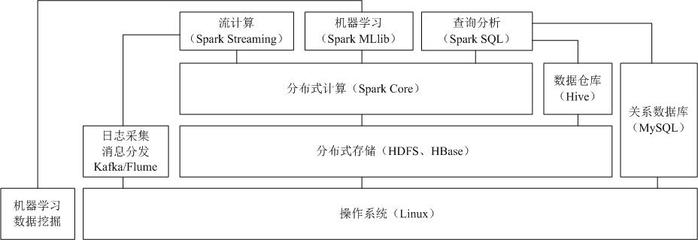

二、Hadoop生态系统核心组件

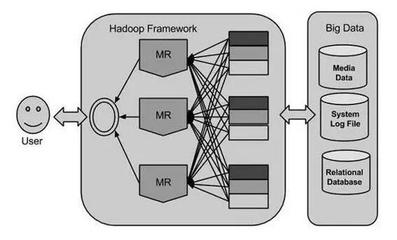

Hadoop并非单一软件,而是一个由多个关键模块组成的生态系统,其中两个最核心的组件是Hadoop Distributed File System (HDFS) 和 Hadoop MapReduce。

1. Hadoop分布式文件系统(HDFS)

HDFS是Hadoop的存储基石。它将超大文件(如TB、PB级)切割成固定大小的数据块(默认为128MB),并将这些数据块副本(默认为3份)分布式地存储在整个集群的多个节点上。这种设计提供了极高的容错性:即使部分节点失效,数据也不会丢失。HDFS采用主从架构,包括一个管理文件系统元数据的NameNode和多个实际存储数据块的DataNode。

2. MapReduce计算框架

MapReduce是Hadoop最初的数据处理引擎。它将计算任务抽象为两个阶段:

- Map(映射)阶段:将输入数据分割成独立的片段,由多个Map任务并行处理,输出一系列的中间键值对。

- Reduce(归约)阶段:将Map阶段输出的、具有相同键的中间结果进行聚合、排序和计算,产生最终的输出结果。

这种编程模型使得开发者无需关心分布式计算的细节,如任务调度、故障恢复和数据通信,只需专注于实现Map和Reduce的业务逻辑。

3. 资源管理与调度框架(YARN)

在Hadoop 2.0之后引入的YARN(Yet Another Resource Negotiator)是一个革命性的改进。它将原先MapReduce中的作业调度和资源管理功能剥离出来,成为一个独立的集群资源管理层。YARN使得Hadoop从一个单一的数据处理系统(仅支持MapReduce)进化成为一个多应用操作系统,允许在同一个集群上运行多种计算框架,如Spark(内存计算)、Flink(流处理)、Hive(SQL查询)等,极大地提升了集群的利用率和生态的丰富性。

三、Hadoop的优势与应用场景

主要优势:

- 高可靠性:数据多副本存储和自动故障恢复机制。

- 高可扩展性:可通过线性增加商用服务器轻松扩展至数千节点。

- 高容错性:能自动处理节点故障,任务会自动转移到健康节点重新执行。

- 成本低廉:基于廉价的x86服务器构建,相比大型机和小型机成本极低。

- 高效性:并行处理模式能高效处理PB级数据。

典型应用场景:

- 海量数据存储与备份:如企业数据湖的底层存储。

- 批量数据ETL:从各种数据源抽取、转换、加载数据到数据仓库。

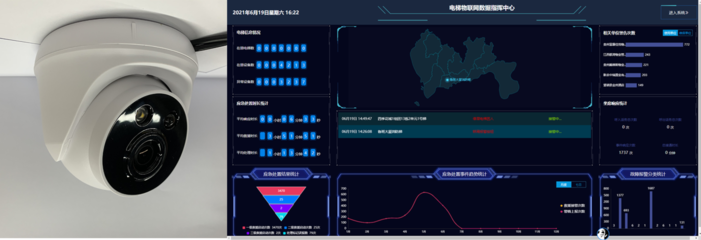

- 日志与用户行为分析:分析网站点击流、应用日志以洞察用户行为。

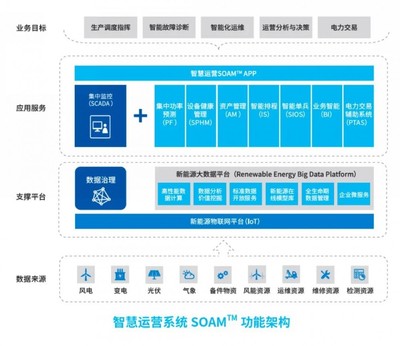

- 机器学习与数据挖掘:为推荐系统、风险模型等提供大规模训练数据预处理能力。

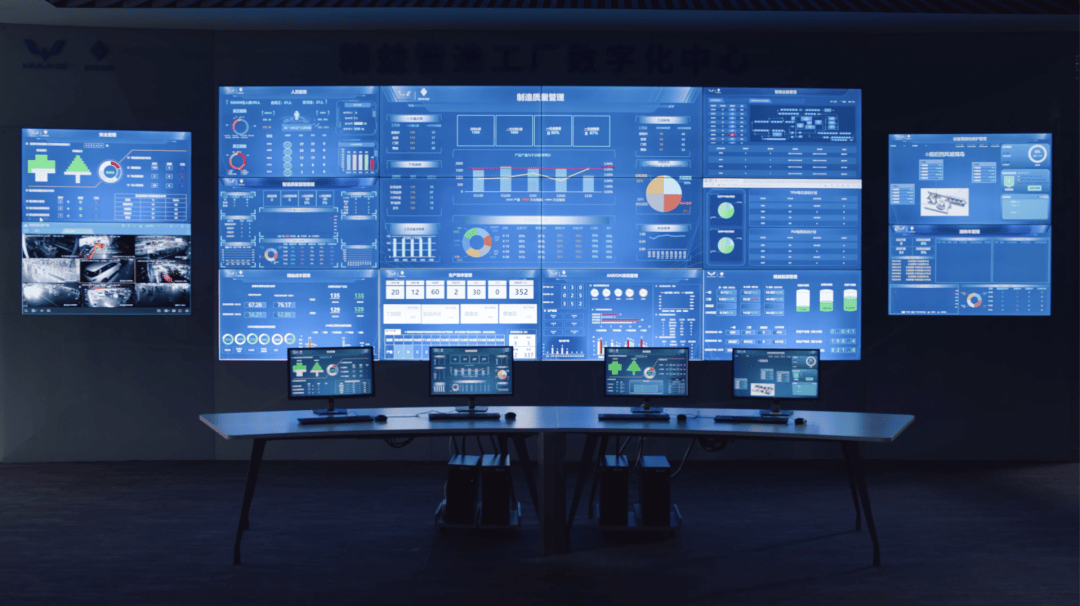

- 离线报表与商业智能:生成每日、每周的汇总统计报表。

四、Hadoop的挑战与演进

尽管Hadoop(尤其是MapReduce)在批处理上表现出色,但其“磁盘密集型”的计算模式(中间结果写磁盘)在面对需要低延迟、交互式查询或实时流处理的场景时存在局限性。因此,Hadoop生态系统也在不断演进:

- 计算引擎多样化:更快的计算框架如Apache Spark(基于内存)、Apache Flink(流批一体)逐渐成为更主流的选择,它们通常运行在由YARN管理的Hadoop集群上,并直接读取HDFS中的数据。

- 云化与容器化:Hadoop的部署模式正从传统的本地集群向云原生架构迁移,利用Kubernetes等容器编排技术进行更灵活的资源管理。

- 存储与计算解耦:对象存储(如AWS S3,阿里云OSS)因其无限扩展性和按需付费模式,开始作为HDFS的替代或补充,用于存储海量冷数据。

###

Hadoop开启了大数据的工业化时代,其提出的分布式存储与计算思想至今仍是整个大数据技术的基石。虽然具体的技术组件在不断迭代更新,但Hadoop生态系统所确立的用廉价硬件集群处理海量数据的范式已经深入人心。对于任何希望踏入大数据领域的技术人员而言,理解Hadoop的核心原理与架构,依然是构建坚实知识体系不可或缺的第一步。它不仅仅是一套工具,更是应对数据洪流时代的一种基础性解决方案。

如若转载,请注明出处:http://www.sdlysll.com/product/22.html

更新时间:2026-04-12 04:22:36